L1, L2 Norm, Loss, Regularization?

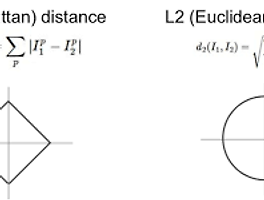

정규화 관련 용어로 자주 등장하는 L1, L2 정규화(Regularization)입니다. 이번에는 단순하게 이게 더 좋다 나쁘다보다도, L1, L2 그 자체가 어떤 의미인지 짚어보고자합니다. 사용된 그림은 위키피디아를 참조하였습니다. Norm 우리가 가장 쉽게 알고 있는 Norm은 절댓값입니다. Norm=절대값이 아니라, 많은 Norm 중 하나가 절댓값인거죠. |-1| = 1 이런식으로 썼었는데, 생각해보면 | ? | 속에는 단순 실수만 아니라 벡터도 들어갔었습니다. |(1,2)|이런식으로요. 그리고 이는 절댓값이 아니라 벡터의 크기 정도로 칭했었죠. Norm이란, 수학적 정의는 복잡하지만 결국 어떤 값의 크기를 계산하여, 비교가 가능하게끔하는 어떤 함수 정도입니다. 그 중 하나가 이제부터 계속 보게될 ..

L1, L2 Norm, Loss, Regularization?

정규화 관련 용어로 자주 등장하는 L1, L2 정규화(Regularization)입니다. 이번에는 단순하게 이게 더 좋다 나쁘다보다도, L1, L2 그 자체가 어떤 의미인지 짚어보고자합니다. 사용된 그림은 위키피디아를 참조하였습니다. Norm 우리가 가장 쉽게 알고 있는 Norm은 절댓값입니다. Norm=절대값이 아니라, 많은 Norm 중 하나가 절댓값인거죠. |-1| = 1 이런식으로 썼었는데, 생각해보면 | ? | 속에는 단순 실수만 아니라 벡터도 들어갔었습니다. |(1,2)|이런식으로요. 그리고 이는 절댓값이 아니라 벡터의 크기 정도로 칭했었죠. Norm이란, 수학적 정의는 복잡하지만 결국 어떤 값의 크기를 계산하여, 비교가 가능하게끔하는 어떤 함수 정도입니다. 그 중 하나가 이제부터 계속 보게될 ..